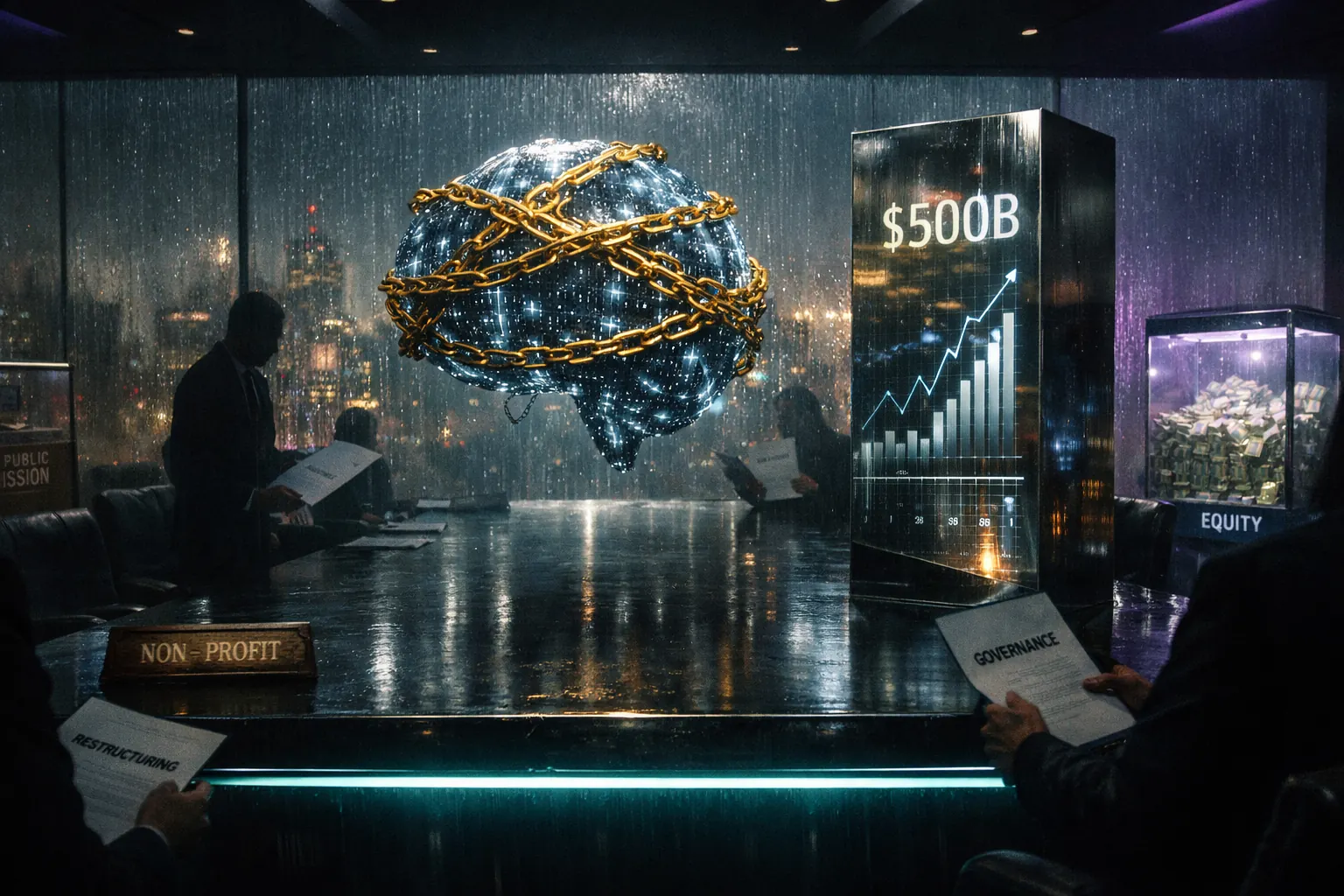

OpenAI: da Non-Profit a Colosso da 500 Miliardi. Il Processo che Ridefinirà l’Intelligenza Artificiale

La battaglia legale tra Elon Musk e Altman solleva interrogativi cruciali su profitto, missione sociale e controllo delle tecnologie che plasmeranno il futuro

Oakland (California) — Il 27 aprile, quando il giudice Yvonne Gonzalez Rogers aprirà l’udienza del caso Musk contro OpenAI, in gioco ci sarà molto più di una disputa tra miliardari. Al centro del processo si trova una questione che definirà il futuro dell’intelligenza artificiale: può un’organizzazione nata come ente benefico trasformarsi in un impero commerciale da 500 miliardi di dollari senza tradire chi l’ha finanziata e, soprattutto, la missione dichiarata di servire l’umanità?

I numeri del caso raccontano una trasformazione vertiginosa. Nel 2015, Elon Musk dona 38 milioni di dollari a OpenAI, organizzazione non-profit con la missione esplicita di sviluppare intelligenza artificiale “per il beneficio di tutta l’umanità”. Undici anni dopo, OpenAI vale 500 miliardi di dollari, Microsoft ne possiede il 27%, e Musk chiede tra 79 e 134 miliardi di danni, sostenendo di essere stato “assiduamente manipolato e ingannato” dai fondatori Sam Altman e Greg Brockman.

Il 13 gennaio 2026, la giudice Gonzalez Rogers ha respinto la richiesta di archiviazione di OpenAI, stabilendo che esiste “abbondante evidenza” per supportare le accuse di Musk e Altman. Il processo con giuria inizierà ad aprile, ma la vicenda ha radici che vanno ben oltre una semplice controversia finanziaria.

I diari di un tradimento annunciato

La chiave del processo risiede nei cosiddetti “Brockman Diaries”, i diari personali del co-fondatore Greg Brockman emersi durante la fase di discovery. Questi documenti rivelano in modo inequivocabile quando e come OpenAI abbia iniziato a deviare dalla sua missione originaria.

Nel novembre 2017, appena due anni dalla fondazione, Brockman annota: “Stiamo pensando che forse dovremmo semplicemente convertirci in for-profit”. Poche settimane dopo, un’altra annotazione rivela il suo disagio morale: “Non posso credere che ci siamo impegnati al non-profit se tre mesi dopo stiamo facendo una b-corp, allora era una bugia”. Quella frase è ora diventata uno degli elementi centrali dell’accusa.

Le comunicazioni interne confermano che i fondatori erano consapevoli delle implicazioni etiche. In un’email emerge la preoccupazione: “Sarebbe moralmente fallimentare convertirci senza di lui [Musk]”. Eppure, quando nel 2018 Musk propone di prendere il controllo diretto fondendo OpenAI con Tesla, il board rifiuta e lo mette da parte, scegliendo Altman come CEO. Musk lascia l’organizzazione, frustrato.

OpenAI ha tentato di difendersi pubblicando email del 2018 in cui Musk sembra concordare sulla necessità di raccogliere “miliardi” di dollari. Ma i legali di Musk sostengono che il contesto mostra come si parlasse di mantenere la struttura non-profit con maggiori fondi, non di privatizzare l’organizzazione.

L’alleanza con Microsoft: quando l’infrastruttura diventa controllo

Il 2019 segna il punto di svolta definitivo. L’arrivo di Microsoft pone un problema tecnico concreto: non si può investire in un’organizzazione non-profit tradizionale senza azioni da acquistare né ritorni economici da capitalizzare. OpenAI trova una soluzione “creativa”: crea una sussidiaria for-profit con struttura “capped-profit”, dove gli investitori possono ottenere ritorni fino a 100 volte l’investimento. Tutto ciò che eccede quella soglia dovrebbe, in teoria, tornare alla missione benefica.

Microsoft investe inizialmente 1 miliardo di dollari, cifra che nel corso degli anni raggiungerà circa 13 miliardi in denaro contante. Oggi Microsoft detiene il 27% di OpenAI, partecipazione valutata circa 135 miliardi di dollari dopo la ristrutturazione completata nell’ottobre 2025.

Ma i numeri reali dell’accordo sono molto più significativi. OpenAI si è impegnata ad acquistare 250 miliardi di dollari di servizi cloud Azure nei prossimi anni. Microsoft fornisce l’infrastruttura computazionale — server, chip GPU Nvidia, data center — essenziale per addestrare modelli come GPT-4 e GPT-5.

Questa dipendenza crea una forma di controllo che trascende la semplice partecipazione azionaria. OpenAI non può facilmente cambiare fornitore cloud: i modelli sono ottimizzati per l’architettura Azure, i dataset risiedono nei server Microsoft, l’intera pipeline di training è profondamente integrata. Alcuni analisti definiscono questo meccanismo “infrastruttura come controllo”, una subordinazione più sottile ma più vincolante del possesso di azioni.

Durante la discovery sono emersi anche messaggi di testo notturni del CEO di Microsoft, Satya Nadella. I team legali li hanno esaminati cercando prove di coordinamento strategico che potrebbero supportare l’accusa secondo cui OpenAI è diventata una “sussidiaria de facto” di Microsoft. Microsoft ha negato di aver “aiutato e favorito” OpenAI nelle presunte violazioni, ma la giudice Gonzalez Rogers ha stabilito che “molto è stato fatto in segreto” e che la questione merita l’esame della giuria.

I lavoratori invisibili dietro ChatGPT

Mentre a San Francisco si celebrava l’innovazione di OpenAI, a Nairobi si svolgeva un tipo di lavoro che ha reso possibile ChatGPT nella forma in cui lo conosciamo. Un’inchiesta di TIME ha rivelato che OpenAI ha assunto lavoratori kenioti tramite l’azienda di outsourcing Sama, pagandoli tra 1,32 e 2 dollari l’ora per leggere ed etichettare decine di migliaia di contenuti estratti dagli “angoli più oscuri di internet”: descrizioni grafiche di abusi sessuali su minori, bestialità, omicidi, suicidi, torture.

“Era una tortura”, ha raccontato un lavoratore a TIME. “Leggerai molte affermazioni del genere per tutta la settimana. Arrivati al venerdì, sei turbato dal pensare a quelle immagini.”

Questi lavoratori stavano addestrando il sistema di moderazione di ChatGPT, il filtro che impedisce al chatbot di generare contenuti inappropriati. Senza il loro lavoro traumatizzante e drammaticamente sottopagato, ChatGPT non sarebbe utilizzabile da milioni di persone.

Il contrasto economico è significativo: OpenAI aveva promesso di pagare a Sama 12,50 dollari l’ora per lavoratore, ma i lavoratori ne ricevevano effettivamente circa 2. Sama tratteneva la differenza, un markup del 500%. L’azienda ha cancellato tutti i contratti con OpenAI nel febbraio 2022, otto mesi prima del previsto, citando la natura traumatica del lavoro. Tutti e quattro i lavoratori intervistati da TIME hanno descritto di sentirsi “mentalmente segnati” dall’esperienza, con sessioni di supporto psicologico promesse ma rare e inefficaci sotto la pressione di raggiungere obiettivi di produttività.

Kate Crawford, ricercatrice del USC Annenberg e autrice di “Atlas of AI”, ha documentato estensivamente questi meccanismi. Nel suo lavoro definisce l’intelligenza artificiale come “una tecnologia di estrazione: dai minerali estratti dalla terra, al lavoro prelevato da lavoratori dell’informazione a basso salario, ai dati raccolti da ogni azione ed espressione”.

Il caso kenioto non è isolato. Lavoratori nella cosiddetta “human in the loop” si trovano in India, Filippine, Venezuela e altri paesi con salari bassi ma popolazioni istruite. Secondo alcune stime, circa 100 milioni di persone nel mondo lavorano o hanno lavorato nell’etichettatura dati per sistemi di intelligenza artificiale.

Le contraddizioni di Musk e Altman

La posizione di Musk come accusatore presenta tuttavia contraddizioni significative. Nella primavera del 2023, ha lanciato xAI, la sua azienda di intelligenza artificiale con il chatbot Grok, dichiarando l’obiettivo di creare un’AI “più aperta e meno censurata” di ChatGPT.

Ma nel 2025, Musk ha abbandonato lo status di benefit corporation per xAI, fondendo la società direttamente con X (ex Twitter) — esattamente il tipo di mossa commerciale che critica in OpenAI. Recentemente, Grok ha permesso agli utenti di creare facilmente deepfake pornografici non consensuali e immagini di abuso generato dall’AI, innescando indagini da parte della Commissione Europea, India, Malesia e Australia.

Nel febbraio 2025, Musk ha anche fatto un’offerta non richiesta per acquisire OpenAI valutandola 97,4 miliardi di dollari. Altman l’ha rifiutata sarcasticamente su X: “No grazie, ma compreremo Twitter per 9,74 miliardi se vuoi”. OpenAI ha sostenuto che l’offerta fosse una “tattica commerciale” progettata per interferire negli affari dell’azienda.

Meredith Whittaker, presidente di Signal e co-fondatrice dell’AI Now Institute, ex-dipendente Google che organizzò il celebre walkout del 2018 contro i contratti militari, offre una lettura più strutturale della questione. Pur condividendo alcune preoccupazioni sulle aziende che traggono profitto dall’AI, Whittaker si dichiara “scettica sull’hype di ChatGPT” e non vede alcun valore rivoluzionario nella tecnologia generativa.

In un’intervista del 2024, ha articolato una critica più ampia: “Senza la capacità di agire su quell’informazione, senza agency, la trasparenza è una flex, un’espressione di potere, non realmente un meccanismo che informa la governance”. In altre parole, OpenAI può pubblicare tutti i report sulla sicurezza che desidera, ma finché il controllo resta nelle mani di un’élite tecno-finanziaria ristretta, la trasparenza rimane simbolica.

Le domande che definiranno il futuro dell’AI tra Musk e Altman

Al di là delle questioni legali specifiche, il processo solleva tre interrogativi strutturali che trascendono la controversia tra Musk e OpenAI.

Primo: le organizzazioni non-profit possono legittimamente trasformarsi in imperi commerciali? OpenAI sostiene che la struttura “capped-profit” preserva la missione benefica. L’ente non-profit originale, ora OpenAI Foundation, detiene il 26% della public benefit corporation, valutato circa 130 miliardi di dollari, rendendola secondo l’azienda “una delle fondazioni non-profit meglio finanziate di sempre”.

I critici obiettano che il controllo effettivo risiede nelle mani di Microsoft e degli investitori privati, e che la “missione per l’umanità” è inevitabilmente subordinata alla necessità di giustificare una valutazione di 500 miliardi. Come può un ente benefico competere con gli interessi di Microsoft, Nvidia e decine di venture capital che hanno investito miliardi aspettandosi ritorni significativi?

Secondo: chi possiede i risultati della ricerca finanziata da donazioni? Questa è forse la questione più delicata. Tutti i modelli sviluppati durante la fase non-profit (2015-2019) — GPT, GPT-2, parte di GPT-3 — sono stati addestrati con fondi donati da Musk e altri benefattori sotto l’assunto che sarebbero stati un bene pubblico. Ora quei modelli, o le loro evoluzioni dirette, alimentano prodotti commerciali che generano miliardi di dollari di revenue.

Terzo: esistono modelli alternativi di governance dell’AI? Crawford, nel suo “Atlas of AI”, identifica il problema sistemico senza offrire soluzioni facili: “L’AI accelera governance non democratica e aumenta disuguaglianze razziali, di genere ed economiche”. Il suo lavoro documenta come l’intelligenza artificiale non sia affatto “artificiale” o immateriale, ma profondamente radicata in catene di estrazione che vanno dalle miniere di litio alle condizioni di lavoro precarie in Africa.

I modelli cooperativi o veramente open-source nell’AI enterprise rimangono marginali. Gli esempi esistenti — EleutherAI, parti di Hugging Face, alcuni progetti accademici — operano su scala microscopica rispetto ai giganti da trilioni di dollari e non hanno accesso alla potenza computazionale necessaria per competere.

I possibili scenari e le loro conseguenze

Due esiti principali emergono dal processo di aprile, ciascuno con implicazioni significative per l’intero settore tecnologico.

Se Musk dovesse vincere, OpenAI potrebbe essere costretta a una ristrutturazione drastica. L’esperto finanziario di Musk, C. Paul Wazzan, ha calcolato che OpenAI ha ottenuto guadagni illeciti tra 65,5 e 109,4 miliardi di dollari, mentre Microsoft avrebbe guadagnato tra 13,3 e 25,1 miliardi. Tuttavia, una vittoria di Musk difficilmente creerebbe un sistema più equo — più probabilmente frammenterebbe l’azienda lasciando il controllo ad altri miliardari, con xAI ben posizionata per raccogliere i pezzi.

Se invece OpenAI e Microsoft dovessero prevalere, si consoliderebbe un precedente preoccupante: le organizzazioni non-profit potrebbero trasformarsi in imperi commerciali trilionari mantenendo una facciata formale di “missione sociale” attraverso una fondazione minoritaria. Altri potrebbero seguire questo modello: raccogliere donazioni fiscalmente deducibili e attrarre talenti idealisti nella fase iniziale, per poi privatizzare i risultati quando arriva il momento della monetizzazione.

Il vero verdetto, tuttavia, potrebbe non arrivare dall’aula di tribunale di Oakland. La questione fondamentale rimane aperta: chi dovrebbe controllare le tecnologie che plasmeranno il futuro dell’umanità?

Mentre Musk e Altman si contendono miliardi in tribunale, migliaia di lavoratori in Kenya, India e Filippine continuano a etichettare dati per circa 2 dollari l’ora. Centinaia di milioni di utenti di ChatGPT non hanno alcuna voce su come viene sviluppata la tecnologia che utilizzano quotidianamente. I ricercatori che hanno costruito i modelli originali durante la fase non-profit non vedranno una frazione dei 500 miliardi di valutazione che il loro lavoro ha generato.

La giuria deciderà su frode, violazione fiduciaria e arricchimento ingiusto. Ma non affronterà la domanda più importante: l’intelligenza artificiale è un bene comune da governare democraticamente o una proprietà privata da estrarre per profitto?

Quella risposta verrà scritta altrove — da movimenti di lavoratori del settore tecnologico che iniziano a organizzarsi, da regolatori che tentano approcci alternativi come l’AI Act europeo, e forse da una società civile che deciderà che la posta in gioco è troppo alta per essere lasciata esclusivamente ai miliardari della Silicon Valley.

Il processo inizia il 27 aprile. Ma la vera battaglia per definire il futuro dell’intelligenza artificiale è appena iniziata.

Fonti Musk e Altman

- OpenAI — The truth Elon left out

- AP News — Judge indicates Elon Musk’s fraud lawsuit against OpenAI will head to trial

- Westlaw — Big Tech Docket: Musk’s suit against OpenAI to proceed to trial

- OpenAI — The next chapter of the Microsoft–OpenAI partnership

- TIME — OpenAI Used Kenyan Workers on Less Than $2 Per Hour to Make ChatGPT Less Toxic

- Yale University Press — Atlas of AI (Kate Crawford)

- TechCrunch — OpenAI completes its for-profit recapitalization