TRIBE V2 E LA MENTE MISURABILE

Tribe v2 è Il primo gemello digitale del cervello umano: come funziona, cosa cambia in medicina, e cosa rischiamo davvero

INCHIESTA · NEUROSCIENZA COMPUTAZIONALE · AI · APRILE 2026

▶ Ascolta l’articoloUna macchina che prevede come il vostro cervello risponde a una canzone, una notizia, un volto senza scanner, senza elettrodi, in pochi secondi

Immaginate di ascoltare una canzone che conoscete da vent’anni. Non la sentite soltanto: qualcosa si sposta dentro di voi — malinconia, euforia, un ricordo preciso che non avevate chiamato. Quello spostamento non è metafora. È fisico: milioni di neuroni aumentano il consumo di ossigeno, il sangue affluisce nelle zone che elaborano memoria ed emozione. Il cervello cambia forma metabolica in risposta a ciò che percepisce. Ora immaginate che un sistema informatico — senza scanner, senza elettrodi, senza che voi lo sappiate — possa predire esattamente come la vostra corteccia reagisce a quella canzone, a quel titolo di giornale, a quel volto politico sullo schermo. È quello che fa TRIBE v2, il modello rilasciato da Meta il 26 marzo 2026.

Per capire la portata del cambiamento, serve capire cosa esisteva prima. La risonanza magnetica funzionale — fMRI — è stata per trent’anni lo strumento principale della neuroscienza cognitiva: misura le variazioni di ossigenazione del sangue in risposta all’attività neurale, traducendole in mappe 3D dell’attivazione cerebrale. Potente, ma strutturalmente limitata in tre modi. Il primo è di tempo: i neuroni comunicano in millisecondi, il flusso sanguigno risponde in due-cinque secondi. Il secondo è di contaminazione corporea: ogni respiro, ogni battito cardiaco, ogni microtremore muscolare introduce variazioni magnetiche sovrapposte al segnale neurale. Il terzo è economico: un’ora di scanner fMRI in un ospedale di ricerca costa tra i mille e i tremila dollari, richiede approvazione etica, volontari, tecnici specializzati.

TRIBE v2 (TRansformer for In-silico Brain Experiments), accettato alla conferenza ICLR 2026, aggira questi tre problemi contemporaneamente. Non è uno scanner migliore: è un modello che ha imparato, su oltre 1.115 ore di scansioni reali di 720 volontari, come il cervello umano risponde statisticamente a qualsiasi stimolo visivo, sonoro o linguistico. Dato un video, un brano audio, un testo — produce in pochi secondi una mappa tridimensionale dell’attivazione corticale su circa 70.000 punti spaziali. Le sue previsioni risultano più accurate della scansione fMRI di un singolo individuo reale, perché filtrano tutto il rumore corporeo che ogni scanner fisico inevitabilmente registra insieme al pensiero. Non è fantascienza. È un cambiamento di paradigma — e come tutti i cambiamenti di paradigma, porta con sé opportunità reali e rischi che la società non è ancora attrezzata a governare.

Dal sensore al voxel

Come tre modalità sensoriali vengono fuse in una mappa dell’attivazione cerebrale su 70.000 punti corticali

Tri-Modale

- Video V-JEPA2-Giant 64 frame · 4 secondi · relazioni semantiche

- Audio Wav2Vec-BERT 2.0 Strutture acustiche · campionamento 2 Hz

- Testo LLaMA 3.2-3B 1.024 token di contesto · narrativa temporale

D=384

Temporale

- Dipendenze cross-modali

- Integrazione multisensoriale

- Rappresentazione universale

- Pattern cognitivi condivisi

soggetto

Corticale

corticali

predetti

fsaverage5 standard

modello precedente

dataset di training

elaborate

modelli standard

Tribe v2, Come funziona: tre sensi, un trasformatore, settantamila punti

Il modo più diretto per capire l’architettura di TRIBE v2 è pensare a come funziona la comprensione umana di un film. Mentre guardate una scena, il cervello elabora contemporaneamente il movimento sullo schermo, il dialogo, la musica di sottofondo, e li fonde in un’unica esperienza narrativa ed emotiva. Nessuno di questi canali esiste indipendentemente dagli altri: la musica cambia il senso delle immagini, le parole modificano l’interpretazione dei volti. TRIBE v2 replica questa struttura di elaborazione parallela e fusione.

Il sistema sfrutta tre modelli di intelligenza artificiale già esistenti come estrattori specializzati. Per il video, usa V-JEPA2-Giant, che analizza sequenze di 64 fotogrammi cercando le relazioni semantiche tra ciò che si muove in scena. Per l’audio, usa Wav2Vec-BERT 2.0, che scompone il paesaggio sonoro nelle sue strutture acustiche fondamentali. Per il testo, usa LLaMA 3.2-3B con un contesto di 1.024 parole precedenti — perché il cervello umano, come il modello, non elabora le parole in isolamento ma nel filo della narrazione. I tre flussi vengono poi compressi e fusi da un Trasformatore Temporale — il nucleo del sistema — che apprende le dipendenze reciproche tra modalità nel tempo: non somma visione, suono e linguaggio, ma apprende a quale punto temporale e in quale combinazione il cervello umano produce le sue risposte più caratteristiche.

Le previsioni di TRIBE v2 risultano più accurate della scansione fMRI di un singolo individuo reale. Il modello computazionale diventa, paradossalmente, un gold standard biologico.

L’output finale è una mappatura su 70.000 voxel della superficie corticale — proiettata sulla mesh standard fsaverage5 — che mostra quali aree del cervello si attiverebbero, e con quale intensità, in risposta allo stimolo intero. Avendo estratto le regolarità universali della corteccia da 720 soggetti diversi, TRIBE v2 predice l’attività cerebrale di persone che non ha mai scansionato, su compiti che non ha mai visto, in lingue non presenti nel dataset originale. Il team di Meta ha alimentato TRIBE v2 con gli stessi stimoli usati nel dataset IBC (Individual Brain Charting): il sistema ha riprodotto in simulazione la localizzazione dell’area fusiforme dei volti, dell’area paraippocampale dei luoghi e dell’area di Broca per la sintassi — aree che la neuroscienza ha impiegato decenni e milioni di dollari per cartografare.

Da Broca a TRIBE v2: centosessantacinque anni di una traiettoria

TRIBE v2 non è caduto dal cielo nel 2026. È il punto d’arrivo di una traiettoria intellettuale lunga centosessantacinque anni, durante la quale la scienza ha progressivamente smontato l’idea che la mente fosse qualcosa di separato dal corpo — e ha imparato, lentamente, a misurarla. Paul Broca stabilì che la mente ha coordinate fisiche. Donald Hebb spiegò come quelle coordinate cambiano con l’esperienza. Domenico Parisi dimostrò che l’esperienza che conta è quella incarnata, situata, ecologica — e che chi controlla l’ambiente controlla indirettamente la struttura cognitiva che vi emerge. Il laboratorio LARAL dell’ISTC-CNR di Roma, fondato da Parisi nel 1985, produsse in vent’anni di ricerca la dimostrazione computazionale più solida di questo principio: reti neurali ecologiche che sviluppano spontaneamente strutture identiche alle place cells dell’ippocampo, circuiti emotivi che emergono come strumenti di sopravvivenza, simboli che acquisiscono significato solo attraverso l’ancoraggio sensomotorio all’esperienza fisica. Il paper del 2004 di Cangelosi e Parisi su Brain and Language usò persino l’espressione “synthetic brain imaging” trent’anni prima di TRIBE v2.

Il team FAIR di Meta ha tradotto questa intuizione in architettura computazionale su scala industriale. Tra il 2021 e il 2024, lo studio sistematico della corrispondenza tra le rappresentazioni interne dei modelli visivi auto-supervisionati (DINOv2) e l’attività reale della corteccia visiva umana — misurata con fMRI a 7 Tesla — ha rivelato che i Vision Transformer addestrati senza etichette umane sviluppano gerarchie di elaborazione spontaneamente parallele alla via ventrale visiva biologica. Questa convalida ha posto le fondamenta teoriche per il salto successivo: dall’allineamento visivo all’integrazione multisensoriale completa di TRIBE v2.

Il filo che porta al gemello digitale

Come la scienza ha imparato a leggere, misurare e simulare la mente in centosessantacinque anni

Confronto con la ricerca medica: funzione contro struttura

Nel 2026 il panorama dei foundation model cerebrali si è affollato, e il confronto più illuminante è con BrainIAC, sviluppato dal Mass General Brigham affiliato ad Harvard e pubblicato su Nature Neuroscience. I due sistemi sembrano occupare lo stesso campo — cervello, intelligenza artificiale, neuroimaging — ma rispondono a domande fondamentalmente diverse.

| Asse | TRIBE v2 · Meta FAIR | BrainIAC · Harvard MGH |

|---|---|---|

| Tipo di dati | fMRI funzionale dinamica (segnale BOLD) | MRI strutturale anatomica statica |

| Corpus training | 1.115h fMRI · 720+ volontari sani | 48.965 scansioni MRI cliniche eterogenee |

| Input operativo | Video, audio, testo naturalistico | Sezioni anatomiche 3D in grayscale |

| Domanda fondamentale | Come risponde questo cervello a questo stimolo? | Questo cervello è malato? In che modo? |

| Output clinico | Mappa corticale dell’attivazione cognitiva | Età cerebrale, rischio demenza, firma tumorale |

| Generalizzazione | Zero-shot: soggetti e lingue inedite | Cross-istituzionale: scanner diversi, patologie rare |

| Uso clinico attuale | Sperimentale (Alzheimer, BCI, neuromodulazione) | Diagnostica oncologica e neurodegenerativa attiva |

BrainIAC vede la struttura — fotografa il cervello come è fatto, cerca anomalie morfologiche, calcola se il volume dell’ippocampo si è ridotto al di sotto della soglia di rischio per la demenza. TRIBE v2 vede la funzione — prevede come quella struttura risponde al mondo, come processa un discorso politico o una melodia. I due approcci sono complementari: BrainIAC rileva il danno strutturale nell’Alzheimer precoce; TRIBE v2 misura in simulazione quanto quel danno ha già compromesso le reti di associazione semantica. Usati insieme, potrebbero anticipare la diagnosi di anni rispetto a qualsiasi metodologia attuale.

Entrambi i sistemi ereditano i vincoli del neuroimaging su cui sono stati addestrati. La fMRI è cieca alla dinamica elettrica neurale millisecondo per millisecondo: vede il metabolismo, non il calcolo. Modelli addestrati su segnali ad alta fedeltà temporale — come tracciati ECoG endocranici — potrebbero in futuro superare questo tetto fisico. Ma quella frontiera richiede dati che oggi esistono solo in contesti neurochirurgici altamente specializzati.

I rischi che nessuno vuole nominare ad alta voce

Il comunicato stampa di Meta parla di neuroscienza accelerata, malattie neurologiche, beneficio per l’umanità. Tutto questo è reale. Ma il modello è open-source, gira su GPU consumer, ed è stato costruito da un’azienda il cui modello di business principale è vendere attenzione umana agli inserzionisti. Tenere queste due cose insieme richiede un esercizio di lucidità che la narrativa entusiasta del momento non facilita.

Rafael Yuste, neurobiologista a Columbia University e cofondatore della Neurorights Foundation, ha coordinato nel 2024 un’analisi sistematica dei contratti utente di 30 aziende di neurotecnologia consumer: 29 su 30 si riservano diritti illimitati sui dati neurali degli utenti. 16 su 30 si riservano esplicitamente il diritto di venderli a terzi. Yuste introduce il concetto di neurodiscriminazione — il rischio di essere giudicati per predisposizioni neurali prima ancora di agire: non per comportamenti manifesti, ma per pattern cerebrali misurabili.

“There are no rules; the company is taking everything. Companies never self-regulate. We’ve seen that over and over again, on the internet, with the metaverse, with social media.”

I dati di Yuste riguardano dispositivi che raccolgono segnali EEG direttamente. TRIBE v2 non raccoglie nulla: inferisce le risposte neurali da contenuti multimediali. Questo lo pone in una zona normativa ancora più profonda.

Marcello Ienca, bioeticista alla Technical University of Munich, ha argomentato in un paper del 2024 su Neuron che le leggi attuali coprono esclusivamente i dati raccolti da dispositivi in contatto con il corpo. I sistemi che inferiscono stati mentali da comportamenti e contenuti — esattamente il tipo di sistema che TRIBE v2 rappresenta — non rientrano in nessuna delle protezioni esistenti, incluse HIPAA e GDPR. Ienca chiama questa categoria “cognitive biometrics”: dati che rivelano la mente senza mai toccare il cervello.

Il neuromarketing senza barriere economiche

Per due decenni, il neuromarketing è rimasto una pratica di nicchia: richiedeva scanner fMRI, laboratori, soggetti reclutati. Il costo per campagna era nell’ordine dei centomila euro — l’unica protezione pratica contro l’uso sistematico della scienza cognitiva per ottimizzare la manipolazione del consumatore. TRIBE v2 rimuove quella barriera. Chiunque disponga di una GPU di medio livello può ora testare decine di migliaia di varianti pubblicitarie, predire quale configurazione massimizza l’attivazione delle aree della ricompensa nel pubblico target — prima ancora che il prodotto venga lanciato, senza reclutare un singolo soggetto.

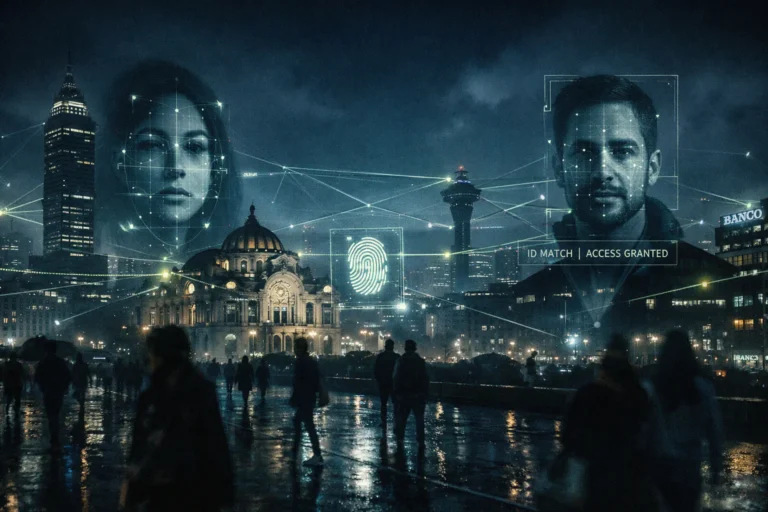

La profilazione cognitiva inferenziale senza consenso

TRIBE v2 non ha bisogno di scansionarvi per modellare come il vostro cervello risponde a qualcosa. Avendo estratto le regolarità universali della corteccia umana, può stimare le vostre reazioni a un contenuto — una campagna politica, un candidato, un prodotto finanziario — a partire dalla conoscenza statistica condivisa di tutti i cervelli umani. Non è lettura del pensiero in senso fantascientifico. Ma può predire come reagireste statisticamente a un determinato stimolo visivo e linguistico — il che, per gli scopi del marketing politico e commerciale, è già abbastanza.

Il bias del campione e la norma che esclude

Il “cervello canonico” di TRIBE v2 è costruito su popolazioni Western, Educated, Industrialized, Rich, Democratic — il WEIRD bias che affligge la neuroscienza cognitiva. Un paziente neurodivergente, anziano, o cresciuto in un contesto culturale diverso la cui risposta neurale devia dalla norma del modello non è necessariamente malato. Ma se il sistema viene usato come se quella deviazione fosse diagnosticamente significativa, il risultato è la patologizzazione sistematica della differenza cognitiva.

Il vuoto normativo strutturale

HIPAA e GDPR sono stati scritti per proteggere dati raccolti in contesti clinici espliciti. Un modello che inferisce l’attività cerebrale a partire da contenuti multimediali pubblici cade in una zona grigia che nessuna delle due normative copre. La California ha fatto un primo passo con SB 1223 (2024), equiparando i dati neurali al DNA nel CCPA — ma questa legislazione copre i dati neurali “raccolti”, non le inferenze cognitive ottenute da comportamenti osservati. Questa distinzione — raccolta vs. inferenza — è il vuoto normativo più urgente che la tecnologia abbia aperto negli ultimi anni.

TRIBE v2 è uno strumento di mappatura, non di comprensione causale. Il gemello digitale del cervello non è il cervello.

TRIBE V2 “Open source”: un’apertura asimmetrica

Meta ha reso pubblici i pesi del modello, il codice sorgente e una demo interattiva sotto licenza CC BY-NC 4.0. Il gesto è stato celebrato come un atto di scienza aperta. Vale la pena esaminarlo più da vicino — perché la vera questione non è la licenza, ma la struttura del potere che essa lascia intatta.

Nita Farahany, professoressa di diritto e filosofia alla Duke Law School, ha descritto nel suo libro The Battle for Your Brain (2023) lo scenario di un datore di lavoro che, durante una trattativa salariale, usa sensori EEG consumer per rilevare che la dipendente è soddisfatta di un’offerta del 2% — mentre l’azienda sarebbe disposta ad arrivare al 10%. Con un sistema come TRIBE v2 — che inferisce le risposte neurali dall’esposizione ai contenuti senza alcun contatto fisico — la stessa asimmetria informativa si replica senza nemmeno la visibilità degli elettrodi.

“Even the staunchest freedom-of-contract libertarian would question the fairness of this negotiation.”

Ciò che è pubblico contro ciò che conta

Meta ha reso pubblico TRIBE v2 nella sua forma attuale — addestrato sui dati che ha scelto di condividere. Ma i dati di training rimangono sotto controllo dell’azienda. La prossima versione del modello — addestrata su più dati, con architettura migliorata — sarà anch’essa di Meta. L'”apertura” riguarda uno snapshot del presente, non l’infrastruttura del futuro.

Il loop dei dati

Meta possiede Instagram, Facebook, WhatsApp, e i visori Quest. Un sistema che unisce comportamento osservato e risposta neurale predetta produce qualcosa di qualitativamente diverso da entrambi presi separatamente. Meta ha entrambi i lati dell’equazione. Chi usa TRIBE v2 open-source ne ha solo uno.

Il posizionamento come standard de facto

Rilasciare uno strumento aperto che diventa lo standard di riferimento in un campo crea un ecosistema di ricercatori, applicazioni e citazioni accademiche costruito attorno alle scelte architetturali e ai bias del dataset di chi ha rilasciato il modello. Il campo della neuroscienza computazionale costruisce su TRIBE v2 — che significa che costruisce su ciò che Meta ha deciso di rendere disponibile, nel modo in cui ha deciso di farlo.

Esiste un argomento solido per la scelta open-source: se TRIBE v2 non fosse stato rilasciato pubblicamente, sarebbe stato sviluppato comunque da altri attori — probabilmente con meno trasparenza, meno peer review, e meno accesso per i ricercatori accademici. L’alternativa all’open-source non è l’assenza del rischio: è il rischio senza la possibilità di esaminarlo.

Quattro livelli.

Un solo attore.

Nessun altro soggetto al mondo possiede simultaneamente tutti e quattro i livelli di questa catena. La loro combinazione è qualitativamente diversa dalla somma dei singoli elementi.

Il loop che Parisi non poteva immaginare

Gli esperimenti del LARAL partivano da un assioma: chi controlla l’ambiente controlla — indirettamente ma sistematicamente — la struttura cognitiva che emerge negli organismi che lo abitano. Nel 1990 era una tesi sperimentale su neuro-robot simulati. Nel 2026 è la descrizione precisa di una condizione reale, a scala planetaria.

Tre virgola cinque miliardi di persone accedono quotidianamente alle piattaforme Meta. La quasi totalità dei ricavi dell’azienda, circa 196 miliardi di dollari su 201 totali, proviene dalla vendita di spazio pubblicitario su queste superfici. Dal 2024, Meta gestisce questo ecosistema attraverso due sistemi documentati pubblicamente. Andromeda inverte il paradigma pubblicitario tradizionale: non parte dal pubblico definito dall’inserzionista per trovare gli annunci adatti, ma parte dalla valutazione del contenuto per trovare le persone più probabili a rispondervi. GEM — Generative Ads Recommendation Model — apprende dall’intero flusso di contenuto organico su tutte le superfici Meta simultaneamente e trasferisce quella conoscenza a tutti gli altri modelli attraverso knowledge distillation. I segnali su cui apprende sono comportamentali: click, watch time, conversioni — eventi che si manifestano dopo che il contenuto ha già raggiunto l’utente. La risposta corticale precede il comportamento di secondi o minuti. TRIBE v2 predice il segnale primario.

Parisi, negli esperimenti di Robotica Interna, aveva mostrato che i circuiti emotivi erano strumenti dell’organismo — funzionali alla sua sopravvivenza. La combinazione TRIBE v2 + GEM crea la possibilità tecnica di ottimizzare i contenuti dell’ambiente informativo per i circuiti emotivi degli utenti: non per la loro fitness cognitiva o per il loro benessere, ma per la conversione dell’inserzionista. Le stesse strutture neurali che nell’evoluzione biologica erano strumenti dell’organismo diventano, nell’ottimizzazione algoritmica dell’ecosistema informativo, punti di ingresso per la modifica del comportamento nel senso di chi controlla l’ambiente.

Il rischio più profondo: quando la norma diventa controllo

C’è un rischio che attraversa tutti gli altri e che raramente viene nominato esplicitamente. Non riguarda un uso malevolo del sistema — riguarda il funzionamento normale di un sistema che lavora esattamente come previsto. Il “cervello canonico” che TRIBE v2 produce è oggettivamente più accurato di qualsiasi misurazione individuale nel predire la risposta del gruppo. Ma è anche, strutturalmente, una norma. Definisce come il cervello umano “dovrebbe” rispondere a uno stimolo. E ogni deviazione da quella norma diventa, automaticamente, misurabile.

La diagnosi normativa

Un sistema clinico che usa TRIBE v2 come baseline per valutare la “salute” cognitiva di un paziente produce — se usato acriticamente — patologizzazione sistematica della differenza cognitiva. Non è uno scenario ipotetico: è la storia ripetuta di ogni strumento di standardizzazione applicato alla variabilità umana.

Il contenuto progettato per il cervello medio

Se i produttori di contenuti ottimizzano sistematicamente i loro output per massimizzare l’attivazione nel cervello canonico di TRIBE v2, il risultato non è solo contenuto più coinvolgente: è contenuto progressivamente più uniforme. L’omologazione culturale prodotta dall’ottimizzazione algoritmica si ripeterebbe, questa volta con il segnale neurologico come funzione obiettivo invece del click.

La risposta “anomala” come segnale di rischio

Se sistemi di sicurezza aziendali o istituzionali adottassero strumenti derivati da TRIBE v2 per verificare se gli utenti rispondono ai contenuti nel modo “atteso”, una risposta cognitiva che devia dalla norma diventerebbe un segnale di allarme. Chi elabora in modo anomalo una certa narrativa potrebbe essere classificato come “disaffezionato” o “a rischio”.

I diritti esistenti non sono stati concepiti per proteggere da sistemi che inferiscono stati mentali senza raccogliere dati neurologici diretti. Ienca formula l’argomento filosofico più netto: la libertà cognitiva è cronologicamente anteriore a qualsiasi altra libertà — senza sovranità sul proprio pensiero, la libertà di parola, di stampa, di coscienza diventano formalmente vuote.

Yuste et al., Nature 2017 · Ienca & Andorno, Life Sciences 2017 · Farahany, 2023I diritti esistenti — libertà di pensiero e integrità mentale — già coprono le sfide poste dalle neurotecnologie, se applicati correttamente. Creare nuovi diritti specifici rischia di indebolirli, dichiarandoli insufficienti. Nel primo caso giudiziario al mondo sui neurorights, in Cile nel 2023, la compagnia ha cancellato i dati in conformità alle leggi già esistenti.

Bublitz, Int. J. Human Rights 2024 · Gálvez, JMIR 2025 · Zaror Miralles, JMIR 2025Entrambe le posizioni convergono su un punto: gli strumenti normativi attuali non sono stati progettati per sistemi che inferiscono la risposta cognitiva da contenuti multimediali pubblici. TRIBE v2 abita precisamente questo spazio non normato — indipendentemente da quale delle due soluzioni si preferisca adottare.

Cosa rimane?

La capacità di misurare il deterioramento delle reti semantiche nell’Alzheimer precoce — prima che il danno strutturale diventi visibile all’MRI — è un vantaggio clinico concreto che potrebbe tradursi in anni di qualità di vita recuperata per milioni di persone. L’accelerazione della ricerca su malattie neurologiche rare, resa possibile da esperimenti virtuali che non richiedono soggetti fisici, è un beneficio reale e immediato. L’abbattimento del costo della ricerca neurologica per istituti universitari in paesi a basso reddito è democratizzazione della conoscenza nel senso più letterale.

Bublitz, il critico più netto dei neurorights come categoria legale nuova, formula questo punto con precisione: quasi metà di noi svilupperà qualche tipo di disturbo cerebrale nel corso della vita. La neurotecnologia potrebbe alleviare quella sofferenza. Il rischio non è la tecnologia in sé. È il vuoto tra la velocità con cui la tecnologia avanza e la lentezza con cui la governance la segue. La domanda non è se usare strumenti come questo. È chi decide le regole d’uso, chi ha accesso ai dati di training, chi audita i bias del modello, e chi paga le conseguenze degli errori.

- Meta FAIR — TRIBE v2: A Foundation Model of Vision, Audition and Language for In-Silico Neuroscience (26 Mar 2026)

- Neuroscience News — Meta’s TRIBE AI Model Decodes Brain Activity

- Khurshid G. — The Brain Has a Foundation Model Now (Medium, Mar 2026)

- Magee P., Ienca M. et al. — Beyond Neural Data: Cognitive Biometrics and Mental Privacy (Neuron, 2024)

- Yuste R., Goering S. et al. — Four ethical priorities for neurotechnologies and AI (Nature, 2017)

- Szoszkiewicz L., Yuste R. — Mental privacy: navigating risks, rights and regulation (EMBO Reports, 2025)

- Ienca M., Andorno R. — Towards new human rights in the age of neuroscience (Life Sciences, 2017)

- Farahany N. A. — The Battle for Your Brain (St. Martin’s Press, 2023)

- Bublitz C. — Neurotechnologies and human rights (International Journal of Human Rights, 2024)

- Gálvez J.C.L., Zaror Miralles D. — (JMIR News & Perspectives, Feb 2025)

- Neurorights Foundation — Survey: Safeguarding Brain Data (Apr 2024)

- Meta Engineering — GEM: Generative Ads Recommendation Model (Nov 2025)

- Search Engine Land — Inside Meta’s AI-driven advertising system: Andromeda and GEM (Feb 2026)

- Meta — Q4 2025 Earnings Report (Jan 2026)

- Varela F., Thompson E., Rosch E. — The Embodied Mind (MIT Press, 1991)

- Cangelosi A., Parisi D. (eds.) — Simulating the Evolution of Language (Springer, 2002)

- Cangelosi A., Parisi D. — The processing of verbs and nouns: Insights from synthetic brain imaging (Brain and Language, 2004)

- Parisi D., Cecconi F., Nolfi S. — Econets: Neural networks that learn in an environment (Network, 1990)

- Parisi D. — Internal robotics (Connection Science, 2004)