Securus come MINORITY REPORT: l’evoluzione della sorveglianza algoritmica nelle prigioni americane

Cos’è la sorveglianza algoritmica? Nel racconto di Philip K. Dick, Minority Report, un sistema predittivo permetteva di arrestare le persone prima avessero compiuto un crimine.

Quella distopia è oggi realtà nelle prigioni americane. Securus Technologies ha addestrato un’Intelligenza Artificiale su anni di comunicazioni carcerarie e, secondo dichiarazioni pubbliche, anche su sette anni di telefonate dal sistema penitenziario del Texas. Kevin Elder, presidente dell’azienda, sostiene che il sistema rilevi i crimini quando vengono “contemplati”. Nel frattempo, i costi delle comunicazioni possono arrivare a livelli predatori: paghi per parlare e, parlando, finanzi lo sviluppo della tecnologia che sorveglia i tuoi cari.

COME SIAMO ARRIVATI QUI

Una telefonata di 15 minuti dal carcere americano può arrivare a costare anche più di 20 dollari. Durante quella chiamata, la compagnia registra ogni parola, ogni pausa, ogni intonazione della voce del detenuto. Quella conversazione con la madre, il figlio o il partner diventa materiale di addestramento per un’Intelligenza Artificiale che viene poi rivenduta alla stessa infrastruttura che detiene chi ha generato i dati.

Securus Technologies ha costruito su questo meccanismo un impero da 1,2 miliardi di dollari, operando un modello di estrazione che penetra e sfrutta ogni livello dell’interazione tra detenuto, famiglia e sistema carcerario. Dall’estrazione sistematica di dati: ogni voce diventa risorsa biometrica archiviata permanentemente, ogni conversazione alimenta archivi proprietari. Fino ai profitti ottenuti dalle tariffe per le chiamate, che appaiono “contenute” ma, per una famiglia che mantiene contatto settimanale, possono trasformarsi in 1200–1500 dollari l’anno solo in comunicazioni. Alla fine del cerchio Securus vende il proprio prodotto: sorveglianza predittiva alle prigioni, scaricando i costi di sviluppo sui detenuti. Soggetti a cui può essere imposta sorveglianza senza consenso. Un campanello d’allarme: se funziona lì, può essere normalizzato ovunque.

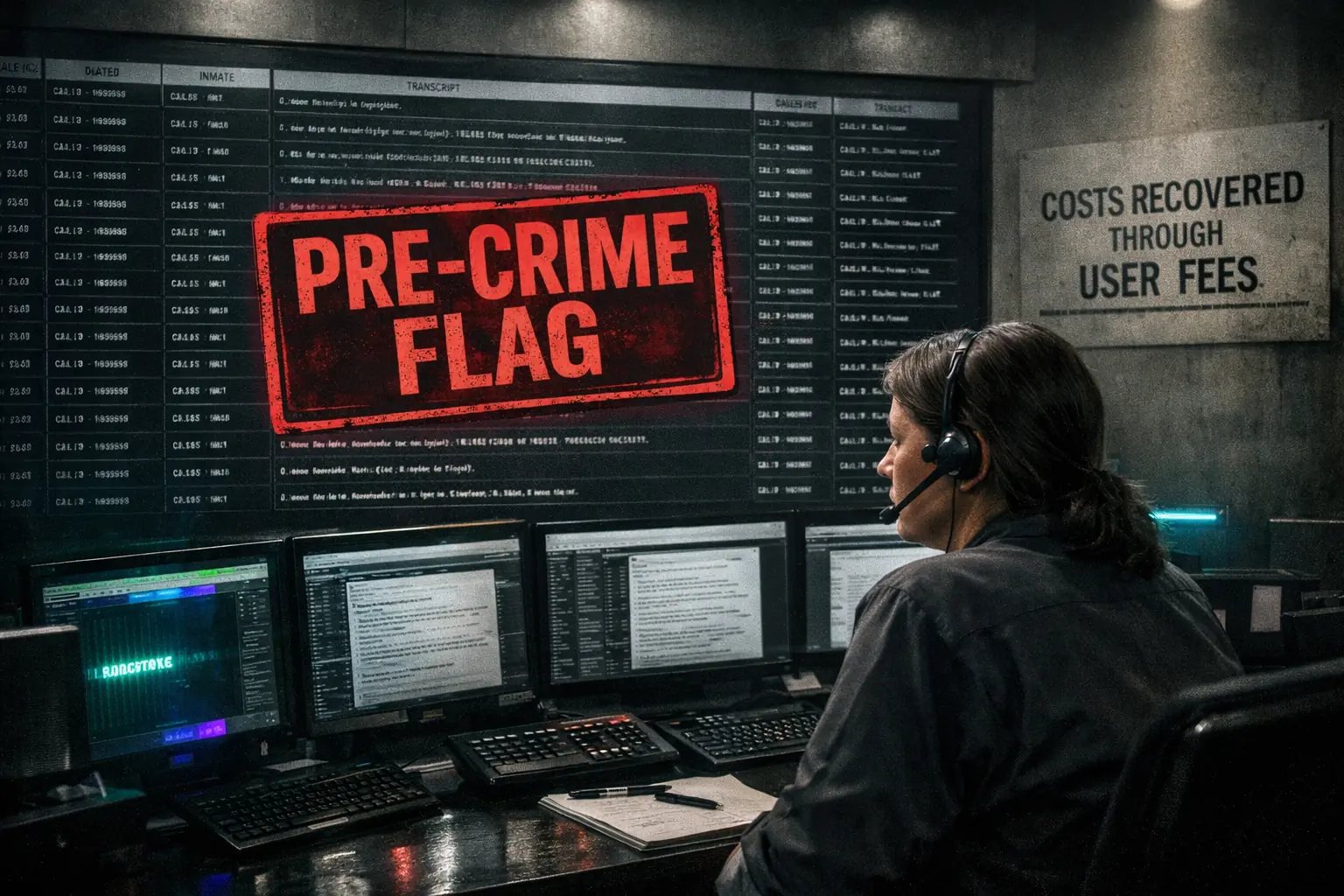

Nel dicembre 2024 l’azienda ammette pubblicamente di aver sviluppato un sistema di sorveglianza predittiva addestrato su anni di comunicazioni dei detenuti — telefonate, videochiamate, email. Kevin Elder parla senza giri di parole: il loro modello linguistico può rilevare “quando i crimini vengono pensati o contemplati, così da intercettarli molto prima nel ciclo”.

Un dettaglio che conta: quando si parla di “sette anni di chiamate”, non si parla di una singola prigione, ma del sistema penitenziario del Texas. E il pilota “in tempo reale” non ha una geografia dichiarata: l’azienda non indica pubblicamente in quali strutture stia operando, tra carceri, prigioni e centri di detenzione (inclusi quelli ICE). L’opacità non è un errore: è il modello.

La parola chiave è “contemplati”. Il sistema non si limita a sorvegliare azioni già compiute: mira ai pensieri, alle intenzioni che ancora non hanno attraversato la soglia tra mente e mondo. L’economia della profezia algoritmica ha trovato il suo laboratorio perfetto: una popolazione priva di alternative, costretta a pagare per comunicare, impossibilitata a rifiutare il consenso.

SORVEGLIANZA ALGORITMICA: ANATOMIA DI UN CRIMINE CHE NON ESISTE

Benvenuti in Minority Report: Securus e l’impero del “pre-crimine”

La storia inizia nel 2023, nelle viscere del sistema penitenziario texano.

Securus controlla le comunicazioni in migliaia di strutture: prigioni statali, carceri di contea, centri di detenzione ICE. Milioni di conversazioni quotidiane attraversano la sua infrastruttura, lasciando tracce permanenti di voci, parole, relazioni.

Prima del 2023, la sorveglianza era spesso reattiva: parole chiave predefinite (“droga”, “arma”, “fuga”) attivavano segnalazioni che operatori umani dovevano verificare ascoltando registrazioni. Un sistema lento, costoso, inefficiente.

L’intuizione di Securus: delegare il lavoro a un’IA capace di processare tutto, sempre, cercando schemi invisibili all’orecchio umano.

Il corpus texano: sette anni di voci

Nel 2023, Securus acquisisce sette anni di registrazioni dal sistema penitenziario del Texas. Centinaia di migliaia di ore di conversazioni, milioni di parole pronunciate da voci che credevano — ingenuamente — di parlare solo alle loro famiglie. Tra quelle registrazioni, anche comunicazioni tra avvocati e assistiti che dovrebbero essere protette dal segreto professionale.

Questo corpus diventa l’archivio di addestramento per un modello linguistico costruito su misura: non Internet generico, non testi pubblici. Il linguaggio carcerario, i codici, gli eufemismi, i pattern emotivi, le strutture relazionali.

La svolta: dal “dopo” al “prima”

Il sistema opera come una catena integrata: la conversazione viene trascritta, analizzata e valutata mentre si svolge. Gli investigatori possono orientare il sistema su detenuti specifici oppure attivare campionamenti sulla popolazione generale.

L’algoritmo evidenzia segmenti classificati “ad alto rischio” secondo criteri opachi. Questi frammenti arrivano a un operatore che decide se approfondire. La “supervisione umana” serve a evitare l’automatismo totale, ma nella pratica rischia di trasformare gli operatori in validatori di verdetti già prodotti dalla macchina.

Securus dichiara prevenzioni e interdizioni, senza però fornire casi verificabili, audit indipendenti, prove pubbliche. Chiede fiducia cieca mentre vende la stessa opacità come “sicurezza”.

Sorveglianza algoritmica a carico dei detenuti

Le famiglie pagano tariffe tra le più alte per comunicare. Securus registra ogni conversazione ottenendo due asset: ricavo immediato dalle chiamate e dati di addestramento per modelli proprietari. Questi dati vengono trasformati in strumenti di sorveglianza e rivenduti alle stesse istituzioni che detengono chi ha prodotto i dati.

La vera innovazione è politica: costruire un quadro in cui “sicurezza” e “IA” diventano giustificazione permanente per tariffe, costi accessori, rinvii e tetti provvisori. Il dispositivo non deve essere perfetto: deve essere pagato, difeso, rinnovato. E il pagamento viene estratto da chi non può dire no.

Paghi per parlare. Parlando, addestri l’IA. L’IA ti sorveglia. Paghi di più per finanziare questa sorveglianza. Il ciclo si autoalimenta: povertà in dato, dato in profitto, profitto in ulteriore estrazione.

Bianca Tylek, direttrice di Worth Rises, lo chiama “consenso coercitivo”: i detenuti non hanno alternative comunicative. O cedono i propri dati biometrici vocali, o rinunciano al contatto con le famiglie.

Il punto di svolta politico: la cronologia FCC (2024–2027)

Il 2024 è l’anno dello scontro regolatorio. Il Martha Wright-Reed Act spinge la FCC a intervenire su tariffe e costi accessori delle comunicazioni carcerarie. Nel 2024 la FCC adotta un ordine di riforma che promette tagli e una nuova architettura di costi. Ma il 20 gennaio 2025 Brendan Carr diventa presidente della FCC e, pochi mesi dopo, arriva la torsione: una deroga sposta l’adeguamento pieno al 1 aprile 2027. Nell’ottobre 2025 vengono votati anche tetti “provvisori” più alti. La conseguenza è semplice: il mercato non viene spezzato, viene prolungato.

Come funziona tecnicamente l’IA di Securus

Il sistema supera la semplice rilevazione di parole chiave. I modelli neurali analizzano significato, contesto temporale, relazioni semantiche distribuite su settimane e mesi di conversazioni.

Ogni chiamata audio passa prima per la conversione voce-testo. Ma la trascrizione non basta: serve identificare i parlanti, distinguere il detenuto dal familiare e riconoscere eventuali altri presenti attraverso caratteristiche biometriche vocali (tono, cadenza, timbro).

Da qui entra in gioco il cuore del sistema: l’attenzione, il meccanismo che mette ogni parola in relazione con le altre, producendo significati “contestualizzati”. Questo permette di collegare frasi apparentemente innocue in una sequenza che il modello interpreta come pianificazione.

L’ultimo livello produce un punteggio probabilistico: non “certezze”, ma probabilità costruite su correlazioni statistiche estratte dall’insieme di addestramento.

Parallelamente, l’analisi delle emozioni valuta cambiamenti nella prosodia (tono, volume, velocità), integrando segnali vocali e testuali. La potenza del sistema emerge dalla memoria: non valuta solo la chiamata corrente, ma l’intero storico comunicativo del detenuto.

SORVEGLIANZA ALGORITMICA: IL BIAS È IL SISTEMA

L’idea che gli algoritmi siano “neutri” ignora la realtà del pregiudizio incorporato: linguaggio, razza, classe, territorio diventano variabili operative.

La scienza del pregiudizio codificato

Studi su modelli NLP hanno mostrato che testi equivalenti, espressi in inglese standard e in African American Vernacular English (AAVE), possono ottenere classificazioni di “tossicità” drasticamente diverse.

Perché? I modelli sono addestrati su corpora dominati dallo standard; varietà linguistiche legittime vengono trattate come “deviazioni”, e quindi associate a aggressività o rischio.

Falsi positivi e spirale autorinforzante

Il sistema può produrre falsi positivi: frasi colloquiali o dialettali, letture fuori contesto, parole ambigue. Quando un gruppo viene segnalato più spesso, le sanzioni che ne derivano generano documentazione “ufficiale” che ritorna nell’insieme di addestramento, consolidando la correlazione spuria: linguaggio non standard = rischio.

Il problema dell’opacità

Se vieni segnalato, non sai perché. Non puoi vedere i dati usati contro di te. Non c’è trasparenza, non c’è audit indipendente, non c’è ricorso reale. La macchina non è solo un sensore: è un criterio di realtà.

SEGUI I SOLDI: LA SORVEGLIANZA ALGORITMICA SOSTENUTA DAI COLOSSI DEL SETTORE

Comprendere Securus significa leggere l’economia dell’incarcerazione come industria: mercati “captive”, contratti, rendite regolatorie, estrazione di valore da povertà e isolamento.

80 miliardi: l’economia dell’incarcerazione

Gli Stati Uniti investono decine di miliardi all’anno per incarcerare milioni di persone. Più della metà dei budget fluisce verso fornitori privati: comunicazioni, tecnologia, sanità, trasporto, infrastrutture di sorveglianza. Non è “solo” prigioni private: è un ecosistema industriale.

Il varco del 13° emendamento

La clausola del 13° emendamento che consente servitù “come punizione per un crimine” ha permesso la continuità storica del lavoro forzato carcerario. Oggi l’estrazione non riguarda solo il lavoro: riguarda i dati cognitivi. Non solo corpi: pensieri trasformati in superficie monetizzabile.

SORVEGLIANZA ALGORITMICA E POLIZIA PREDITTIVA COME DESTINO

Securus non è un’anomalia: è un avamposto. Programmi di polizia predittiva hanno mostrato bias e inefficacia in più contesti, ma la diffusione continua perché il modello economico non dipende dai risultati: vende percezione di controllo, legittima budget, produce contratti.

Dipartimenti di polizia e apparati di sicurezza in tutto il mondo stanno trattando Minority Report non come un monito, ma come un modello di azione. Il film terminava con lo smantellamento del sistema: la morale era chiara. Vent’anni dopo, molte istituzioni scelgono l’opposto.

QUATTRO FRONTI LEGALI PER LA SORVEGLIANZA ALGORITMICA DI SECURUS

Gennaio 2026 segna un momento di svolta: il modello economico di Securus affronta pressioni simultanee su più fronti. Quattro processi paralleli potrebbero ridefinire i limiti operativi dell’azienda.

1. FCC e il Martha Wright-Reed Act: la fine delle tariffe gonfiate

La Federal Communications Commission ha adottato riforme che promettono di separare definitivamente i costi della comunicazione dai “servizi accessori” come la sorveglianza. La norma prevede date di conformità scaglionate tra gennaio 2025 e aprile 2026. Alcuni provider, tra cui Securus, hanno ottenuto deroghe temporanee fino a settembre 2025 per completare l’adeguamento tecnico dei sistemi di fatturazione.

Il cambiamento più evidente: il costo di una chiamata di 15 minuti passerà da oltre 11 dollari in alcune strutture a meno di 1 dollaro. Questo incide direttamente sul modello di business che ha permesso a Securus di finanziare lo sviluppo dell’IA attraverso tariffe elevate. Inoltre, la FCC ha vietato le “site commissions” — accordi in cui i provider condividevano parte dei profitti con le amministrazioni carcerarie.

Securus e altri operatori hanno presentato ricorsi in vari circuiti federali, sostenendo che le nuove tariffe impedirebbero una “giusta compensazione”. I tribunali hanno finora respinto le richieste di sospensione dell’ordine. Anna Gomez, commissaria FCC, ha sottolineato che i costi della sicurezza non dovrebbero ricadere sulle famiglie dei detenuti.

2. Registrazioni di conversazioni avvocato-cliente: un pattern sistematico

Securus ha una storia documentata di registrazioni illecite. Nel 2020, l’azienda e CoreCivic hanno accettato un accordo da 3,7 milioni di dollari per aver registrato comunicazioni tra avvocati e detenuti al Leavenworth Detention Center, condividendo poi queste registrazioni con i procuratori. Cause simili sono emerse in almeno sette stati: California (oltre 14.000 chiamate protette registrate), Kansas, Louisiana, Maine, Missouri, Texas, Wisconsin.

A New York, un audit interno del 2021 ha identificato più di 1.500 chiamate protette registrate, coinvolgendo centinaia di imputati. In un caso in Maine, un avvocato è stato registrato 304 volte mentre parlava con i propri clienti. Le inchieste hanno rivelato che il sistema di trascrizione automatica non sempre distingueva i numeri designati come “protetti”, inserendo materiale privilegiato nei database di addestramento.

David Fathi dell’ACLU ha definito questa situazione “potenzialmente la più massiccia violazione del privilegio avvocato-cliente nella storia americana moderna”. Nel 2015, un leak di database Securus ha esposto 70 milioni di chiamate registrate, incluse decine di migliaia di conversazioni con avvocati.

3. Corte Suprema e dati di localizzazione: il caso in esame

Il 13 gennaio 2026, la Corte Suprema degli Stati Uniti ha accettato di esaminare il potere della FCC di imporre sanzioni alle compagnie telefoniche per la vendita di dati di localizzazione dei clienti. Il caso coinvolge direttamente Securus: uno sceriffo del Missouri ha utilizzato dati di localizzazione forniti dall’azienda (ottenuti a loro volta da AT&T, Verizon e T-Mobile) per tracciare altre persone senza mandato. Lo sceriffo è stato condannato per violazione dei diritti costituzionali.

Nel 2024, la FCC ha imposto sanzioni per un totale di circa 200 milioni di dollari ai tre principali carrier per aver venduto dati di localizzazione a intermediari come Securus. I carrier hanno contestato l’autorità della FCC, sostenendo violazioni procedurali. Le corti federali hanno emesso decisioni contrastanti: il 2° e il DC Circuit hanno confermato le multe, mentre il 5° Circuit ha dato ragione ad AT&T. La Corte Suprema ha consolidato i casi e dovrebbe pronunciarsi entro giugno 2026.

Se la Corte confermerà il potere della FCC, Securus e i partner telco potrebbero affrontare restrizioni stringenti sulla compravendita di dati personali, minando un elemento chiave dell’ecosistema di sorveglianza.

4. California AB 2013: trasparenza sui dati di addestramento

Dal 1° gennaio 2026, la California impone ai developer di sistemi di IA generativa di pubblicare informazioni sui dati usati per l’addestramento. L’Assembly Bill 2013 richiede di dichiarare: le fonti dei dataset, il numero di punti dati, se contengono materiale protetto da copyright, se includono informazioni personali ai sensi del California Consumer Privacy Act, se sono stati usati dati sintetici.

La legge non prevede esenzioni per segreti commerciali. Questo ha generato immediate proteste dall’industria tech: xAI ha fatto causa il 29 dicembre 2025, sostenendo che la norma viola il Quinto Emendamento forzando la divulgazione di informazioni proprietarie. La legge è applicabile attraverso l’Unfair Competition Law della California, permettendo sia azioni pubbliche che private.

Per Securus, questo significa potenziale obbligo di rivelare: il volume di conversazioni usate per addestrare i modelli, se ha incluso comunicazioni protette dal privilegio avvocato-cliente, se ha ottenuto consenso, se ha usato conversazioni di minori. La trasparenza forzata potrebbe esporre pratiche fino a ora coperte dall’opacità dei sistemi proprietari.

L’ALGORITMO CHE CREA IL FUTURO CHE PREVEDE

Abbiamo raggiunto una soglia: la sorveglianza si sposta dalle azioni alle intenzioni, dalla punizione di crimini commessi all’anticipazione di crimini pensati. La “giustizia” rischia di poggiare su probabilità opache, su correlazioni estratte da dati contaminati da decenni di controllo selettivo.

Securus ha architettato un circuito chiuso: povertà in dati, dati in profitto, profitto in ulteriore estrazione. Un dispositivo in cui chi è intrappolato finanzia la propria prigionia a ogni tentativo di contatto umano.

Le novità di gennaio 2026 mostrano crepe significative nel modello: tetti FCC drasticamente abbassati, contenziosi su registrazioni privilegiate, Corte Suprema che esamina vendita di dati personali, California che impone trasparenza sui training dataset. Ma la domanda rimane: basta per fermare l’espansione del “pre-crimine” come infrastruttura?

Una domanda resta sospesa: cosa succede quando l’ultima zona di privatezza — quella regione in cui il pensiero esiste prima di diventare parola — viene trattata come territorio colonizzabile dal profitto?

Una chiamata può costare cifre predatorie; il pensiero, per ora, circola ancora senza tariffa. Ma il modello è già chiaro: crei dipendenza comunicativa, trasformi la comunicazione in dato, vendi il dato come controllo, fai pagare il controllato per finanziare il proprio controllo. Quanto tempo rimane prima che anche pensare diventi un costo di mercato?

Fonti sorveglianza algoritmica

- Scheda Benton.org su articolo MIT Technology Review: IA addestrata su telefonate carcerarie e ricerca di crimini pianificati (dicembre 2024)

- Worth Rises: mappatura dell’industria carceraria e dei soggetti privati (aggiornamento 2024)

- ACLU: comunicazioni carcerarie e sorveglianza di persone che non hanno commesso reati

- Oxford Insights: bias razziale nel trattamento automatico del linguaggio (2019)

- NAACP: nota sul ruolo dell’IA nella polizia predittiva (2024)

- Blodgett & O’Connor (2017): bias linguistico e classificazione dell’AAVE

- FCC: documenti pubblici su riforme delle telecomunicazioni carcerarie (ordine, deroghe, tetti provvisori)

Approfondimenti (aggiornamento 2026)

- FCC: ordine di deroga per Securus su fatturazione video (dicembre 2024)

- Broadband Breakfast: contenziosi su tetti tariffari FCC (luglio 2025)

- Filter Magazine: tribunale respinge tentativi di blocco riforme tariffarie (novembre 2024)

- Prison Legal News: accordo su registrazioni illecite di conversazioni avvocato-cliente (2020)

- Inchiesta: registrazioni di chiamate avvocato-cliente nelle telecomunicazioni carcerarie (2021)

- Worth Rises: protezione dei diritti costituzionali e sorveglianza telefonica (2021)

- EPIC: commenti FCC su implementazione Martha Wright-Reed Act

- MediaPost: Corte Suprema e poteri della FCC su sanzioni privacy (13 gennaio 2026)

- California: testo della legge AB 2013 sulla trasparenza dei dati di addestramento per IA generativa

- Analisi legale: obblighi AB 2013 (entrata in vigore 1 gennaio 2026)

- Analisi legale: contestazioni sulla legge di trasparenza dei dati di addestramento (gennaio 2026)

CYBERMEDIATEINMENT

DECODE > RESIST > RECLAIM