META, nuova funzione Social di protezione per i teenager, Cos’è Davvero?

INSTAGRAM SUPERVISOR: Il compromesso tra privacy e sicurezza che non hai scelto tu

Meta presenta gli alert “salvavita” come tutela dei minori. Ma il supervisore è anche un trasferimento di responsabilità (e un acceleratore di raccolta dati) nel cuore della relazione genitore-figlio.

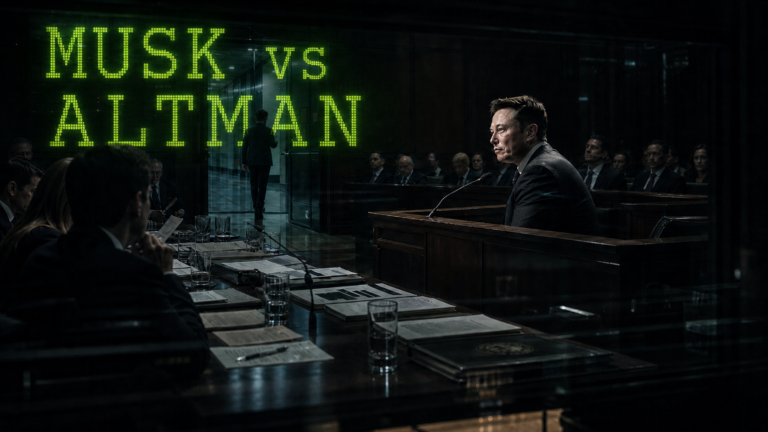

Il 26 febbraio 2026, mentre Mark Zuckerberg usciva dall’aula del tribunale di Los Angeles, Instagram annunciava una nuova funzione: d’ora in poi, i genitori iscritti al programma di supervisione riceveranno un alert — via email, SMS, WhatsApp o notifica in-app — ogni volta che il loro figlio adolescente cercherà ripetutamente termini legati al suicidio o all’autolesionismo.

Ma quale processo? Non un procedimento minore. A Los Angeles è in corso un grande contenzioso in cui Meta e YouTube vengono accusati da famiglie e altri soggetti di aver progettato piattaforme capaci di incentivare uso compulsivo nei minori, minimizzandone i rischi. Dirigenti e testimoni sono stati chiamati a rispondere su meccanismi di engagement, filtri e barriere d’età. In questo contesto, un annuncio di “sicurezza” non è mai neutrale.

La notizia dell’alert ha fatto il giro del mondo: “un primo passo importante”, “Meta si prende cura dei giovani utenti”. Peccato che il tempismo non sia casuale: una feature annunciata mentre l’azienda è sotto scrutinio pubblico e legale funziona anche come scudo narrativo. Non è solo comunicazione sociale: è strategia.

Instagram supervisor e Alert temi sensibili: sicurezza o sorveglianza algoritmica?

La meccanica è semplice: se un teenager cerca più volte in breve tempo termini come “suicidio”, “autolesionismo” (o query affini), il genitore supervisore viene avvisato. L’alert include risorse di supporto per affrontare la conversazione con il figlio.

Ma questa semplicità è ingannevole. Significa che Instagram monitora e classifica in tempo reale le query di ricerca dei minori: non solo quelle che diventano notifica, anche quelle che restano sotto soglia. Il genitore è l’ultimo anello di una catena di decisioni opache: chi definisce la soglia? Chi aggiorna la lista di segnali? Chi conserva i log e per quanto tempo?

Quando la piattaforma dice “ti avviso”, sta anche dicendo: io so — e posso trasformare quell’informazione in un evento registrabile.

C’è poi il contesto che i comunicati stampa non amano: questi strumenti crescono mentre aumenta la pressione regolatoria e legale. La tutela dei minori diventa una lente perfetta per spostare il focus: dalla progettazione (design) alla gestione del rischio (compliance), dal prodotto alla famiglia.

Come funziona davvero Instagram Supervisor: tempo, rete sociale, contenuti

Gestione del tempo. Il genitore può imporre un limite giornaliero: al raggiungimento, l’app si blocca. Il minore può chiedere “ancora tempo”, generando una richiesta in tempo reale. Ogni richiesta/approvazione/rifiuto è un segnale: non solo di uso, ma di dinamica relazionale.

Monitoraggio dei rapporti sociali. Notifiche su nuovi follower/seguiti e possibilità di aprire i profili trasformano il supervisore in una console di intelligence sociale. Il sistema non “mostra solo”: connette eventi sociali a metadati e reazioni.

Instagram supervisor – Teen Accounts: il controllo diventa default

Dal 2024 Meta ha spinto un ulteriore livello: i Teen Accounts, con protezioni “built-in” e impostazioni più restrittive (account privato di default, limitazioni dei messaggi, filtri più stringenti sui contenuti). Per i più giovani, alcune modifiche richiedono il consenso del genitore.

Il passaggio chiave non è la singola protezione: è l’architettura. Quando la sicurezza diventa default, anche la governance dei dati diventa default. E il “Centro per le famiglie” smette di essere un’opzione: diventa un punto di aggregazione.

Il nodo strutturale: le notifiche non riparano il design

Qui emerge la contraddizione: gli alert promettono intervento “a valle”, mentre il danno — se c’è — nasce “a monte”, nel modo in cui i sistemi raccomandano contenuti e modellano l’attenzione. La Molly Rose Foundation ha documentato che, su account test creati come ragazze di 15 anni, contenuti su suicidio, autolesionismo e depressione possono essere raccomandati “a scala industriale”, con percentuali altissime nei flussi di short video.

Questo è il punto: se il sistema di raccomandazione premia intensità emotiva e permanenza, la “sicurezza” rischia di diventare un overlay. Un’interfaccia sopra l’economia dell’attenzione.

Il loop non è un bug: è l’architettura. E un alert non cambia l’architettura.

Chi custodisce i custodi? Dati, responsabilità, rischio

Ogni funzione ha una doppia lettura. Dal lato del genitore: protezione. Dal lato della piattaforma: raccolta e strutturazione di dati nel cuore delle relazioni familiari. Orari (sonno/scuola/pausa), richieste di sblocco, scelte di moderazione, segnali emotivi: tutto può diventare metadato.

E una volta che un database esiste, entra nella storia dei sistemi: può essere riusato, correlato, compromesso, richiesto. Il problema non è la singola feature: è la direzione. La protezione dell’infanzia diventa il cavallo di Troia per normalizzare sorveglianza e governance private su identità e relazioni.

Geopolitica della sicurezza: muro (Australia) vs design law (UE)

Alcuni Paesi spingono su limiti d’età e “age assurance” più robusta, spostando la responsabilità sulle piattaforme e introducendo regimi sanzionatori pesanti. È una via che può ridurre l’accesso dei minori, ma apre il problema della verifica: documenti, biometria, intermediari.

In parallelo, l’Europa — attraverso il Digital Services Act e l’attenzione ai dark pattern — tende a colpire la progettazione: trasparenza, scelta reale, riduzione della manipolazione, alternative non personalizzate. Il confine, però, resta: se l’opzione “sicura” è nascosta o difficile, la libertà è solo formale.

- Reuters (26 feb 2026) — Instagram: alert ai genitori su ricerche ripetute legate a suicidio/autolesionismo

- AP News (feb 2026) — Dettagli sulla feature e canali di notifica (email/SMS/WhatsApp/in-app)

- The Guardian (feb 2026) — Trial a Los Angeles su presunti danni e design additivo dei social

- Molly Rose Foundation (2025) — “Pervasive-by-design” (report PDF)

- Meta (2024) — Annuncio “Instagram Teen Accounts” e protezioni built-in

- eSafety Commissioner (Australia) — Regime di age restriction/age assurance

Post scriptum

La falsa dicotomia è sempre la stessa: o “sorveglianza parentale” delegata a una corporation, o accesso incontrollato. Ma entrambe le opzioni producono dati per la piattaforma. La domanda vera è: perché è Meta a definire cosa significa “proteggere” un minore?

Finché la sicurezza resta un’appendice del modello economico dell’attenzione, ogni tool “salvifico” sarà anche un tool di governance privata: trasferimento di responsabilità, raccolta dati, argomento spendibile in tribunale.